文本分类:自然语言处理的基石

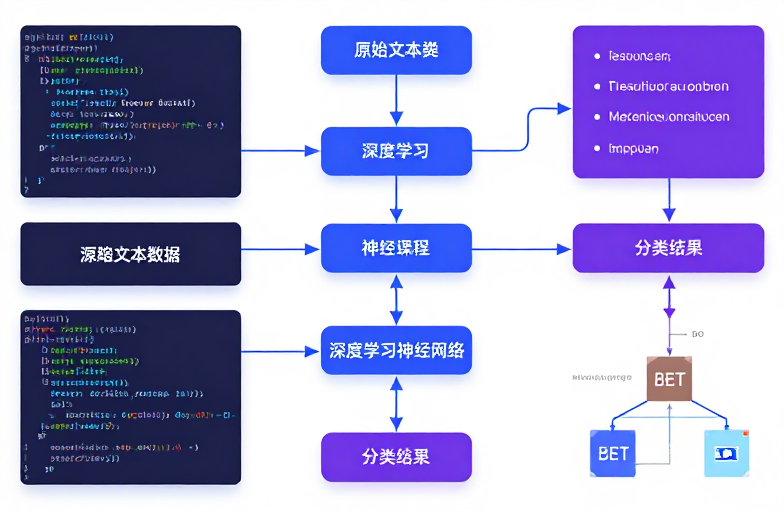

文本分类是自然语言处理(NLP)中最基础也最核心的任务之一,广泛应用于垃圾邮件过滤、情感分析、新闻题材归类及客服意图识别等场景。随着深度学习的发展,文本分类技术经历了从传统统计模型到预训练语言模型的巨大飞跃。

传统方法的局限与突破

早期的文本分类主要依赖TF-IDF特征结合逻辑回归或朴素贝叶斯等算法。这些方法虽然计算高效,但往往难以捕捉上下文语义和词语间的复杂依赖关系。随着Word2Vec和GloVe等词向量技术的出现,模型开始能够理解词语的语义相似度,显著提升了分类效果。

深度学习的革命:CNN与RNN

卷积神经网络(CNN)通过局部感知野提取文本中的n-gram特征,擅长捕捉局部关键信息;而长短期记忆网络(LSTM)则通过门控机制有效解决了长序列依赖问题。在实际应用中,BiLSTM-CRF模型常被用于命名实体识别等序列标注任务,展现了强大的上下文建模能力。

Transformer架构与预训练模型

BERT及其变体(如RoBERTa、DeBERTa)的出现彻底改变了文本分类的格局。基于自注意力机制,这些模型能够双向理解上下文,在极小的微调数据下即可达到甚至超越人类水平的分类准确率。如今,基于Hugging Face Transformers库,开发者可以以寥寥数行代码加载预训练模型,在特定数据集上快速完成微调(Fine-tuning)。

实战建议与最佳实践

- 数据质量至上:确保标注数据的准确性和类别平衡,必要时采用数据增强技术。

- 模型选择:对于资源受限场景,可选择轻量级模型如DistilBERT;对于高精度需求,RoBERTa-large或DeBERTa-v3是更佳选择。

- 提示工程(Prompt Engineering):在少样本(Few-shot)场景下,利用大模型的上下文学习能力,设计巧妙的Prompt模板往往比微调更有效。

文本分类不仅是技术的堆叠,更是对业务场景的深刻理解。选择合适的模型架构与数据策略,才能让算法真正产生业务价值。

未来展望

随着大语言模型(LLM)的普及,零样本(Zero-shot)分类逐渐成为可能。未来的文本分类系统将更加注重可解释性、多模态融合以及持续学习(Continual Learning)能力,以应对动态变化的现实世界需求。